CUDAって、そもそもナニ?

はじめに

最近、AIや機械学習の話題で「GPU」という言葉をよく耳にしませんか?

「ゲームのグラフィクス処理に使うやつでしょ?」

そう思った方、半分正解です。でも今や、GPUはゲームだけじゃなく、AI・科学計算・動画編集・天気予報など、ありとあらゆる「重い計算」の現場で大活躍しています。そして、そのGPUをフル活用するための「仕組み」が…そう、CUDA(クーダ)であり、NVIDIA が開発した GPU を汎用計算に利用するための並列コンピューティングプラットフォーム・プログラミングモデル です。

CPUとGPUの違い

まずは、CUDAを理解する前提として、CPUとGPUの違いを押さえましょう。

CPUは「切れ者のエリート社員」

CPUは、少数精鋭で複雑な仕事をこなすのが得意です。

- コア数は多くても数十個

- 1つひとつのタスクを賢く・速くこなす

- 「順番に考えながら処理する」のが得意

たとえるなら、東大卒のエリート社員が数人いるオフィス。難しい判断や複雑な処理はお手のもの。

合わせて読みたい

GPUは「大人数のアルバイト集団」

一方GPUは、大量の単純作業を一気にこなすのが得意です。

- コア数は数千〜数万

- 1つひとつの能力はCPUより低い

- でも同時並行でガンガン処理できる

たとえるなら、バイトの大軍団が倉庫でひたすら仕分け作業をしているイメージ。難しいことは苦手だけど、単純な作業を圧倒的なスピードでさばける。

合わせて読みたい

CUDAとは?

ここでようやく本題です。

CUDA(Compute Unified Device Architecture)とは、NVIDIA(エヌビディア)が開発した「GPUをプログラミングするための仕組み(プラットフォーム)」です。

2006年に登場したこの技術、一言で言えば──

「GPUをゲーム以外の計算にも使えるようにしちゃおう!」

という革命的なアイデアから生まれました。

CUDAが登場する前

CUDA以前は、GPUは文字通り「グラフィック専用」の装置でした。GPUに計算をさせたければ、わざわざグラフィックス処理のふりをして命令を送るという超まわりくどい方法しかありませんでした。

研究者たちは「GPUめちゃくちゃ速いじゃん、計算に使いたい!」と思いつつも、あまりの使いにくさに頭を抱えていたのです。

CUDAが登場した後

NVIDIAがCUDAを公開したことで、プログラマーはC言語に近い感覚でGPUに仕事を命令できるようになりました。「倉庫のバイト大軍団に、わかりやすい言葉で指示を出せるようになった」イメージです。

合わせて読みたい

CUDAはなぜそんなに重要なの?

AI・機械学習との相性が神がかっている

現代のAI(特にディープラーニング)は、ものすごい量の行列計算を行っています。

たとえば画像認識モデルは、学習中に何億回もの掛け算・足し算を繰り返します。これをCPUでやると何週間もかかる処理が、CUDA対応GPUなら数時間〜数日で終わってしまいます。

ChatGPTのようなAIも、その裏側では大量のNVIDIA GPUとCUDAが動いています。

科学の世界でも大活躍

- 気象・気候シミュレーション

- 創薬・タンパク質の構造解析

- 宇宙物理のシミュレーション

- 金融のリスク計算

これらはどれも「大量の単純計算の繰り返し」という共通点があります。まさにGPU+CUDAの独壇場です。

合わせて読みたい

CUDAのしくみ

少しだけ技術的な話に踏み込んでみましょう。難しい部分は飛ばしてもOKです!

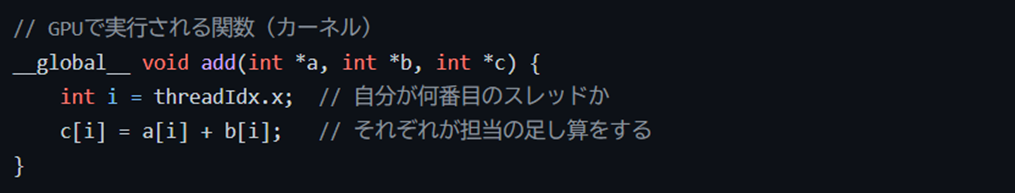

キーワード①:カーネル(Kernel)

CUDAでは、GPUに実行させる関数のことを「カーネル」と呼びます。CPUからGPUに向かって「この関数を○万回、同時にやっておいて!」と命令する、そのひとかたまりのプログラムです。

キーワード②:スレッド(Thread)

GPUは命令を受け取ると、大量の「スレッド」という小さな実行単位を生成して、一気に仕事を分担させます。「1万人のバイトに、それぞれ1個ずつ荷物を担当させる」イメージです。

キーワード③:ホストとデバイス

CUDAの世界では、

- ホスト = CPU(司令塔)

- デバイス = GPU(作業現場)

と呼び分けます。CPUが「こういうデータをGPUに渡して、処理が終わったら結果を返してね」という流れで協調して動きます。

実際のコードを少しだけ覗いてみよう

百聞は一見にしかず。CUDAのコードを一例だけ紹介します。「雰囲気だけ」感じてもらえればOKです。

__global__ という見慣れない記述が目に入ると思います。これが「この関数はGPUで動かすよ」というCUDA特有の印です。

たったこれだけで、何万というスレッドが同時に足し算を実行するプログラムになるわけです。シンプルですよね。

CUDAを使うには何が必要?

「やってみたい!」という方のために、基本的な必要条件を。

| 必要なもの | 詳細 |

| NVIDIAのGPU | GeForceやQuadro、Tesla系など。AMDのGPUでは動きません |

| CUDAツールキット | NVIDIAの公式サイトから無料でダウンロードできる |

| 対応OS | Windows / Linux / macOS(※macOSは古いバージョンのみ) |

注意点として、CUDAはNVIDIA専用技術です。AMD製GPUでは動きません。AMD向けには「ROCm」という別の仕組みがあります。

合わせて読みたい

CUDAを直接使わない選択肢もある

「コードは書きたくないけど、GPUの恩恵は受けたい」という方も多いはず。安心してください。CUDAを直接触らなくてもGPUを活用できるツールやライブラリが山ほどあります。

- PyTorch / TensorFlow ─ AI・機械学習の定番フレームワーク。裏でCUDAが動いている

- cuBLAS ─ 線形代数の高速計算ライブラリ

- OpenCV(GPU版) ─ 画像処理ライブラリ

Pythonで model.to('cuda') と書くだけでGPU学習が始まる──これも全部CUDAのおかげです。

合わせて読みたい

まとめ

最後に、この記事のポイントを振り返りましょう。

- CUDAとは、NVIDIAが開発した「GPUを汎用計算に使うための仕組み」

- GPUは大量の並列計算が得意で、AIや科学計算に超絶向いている

- CUDAのおかげで、現代のAIブームが実現したと言っても過言ではない

- 直接使わなくても、PyTorchなどのライブラリ経由で恩恵を受けられる

「GPUってゲームのものじゃないの?」という疑問から始まって、現代AI技術の根幹に触れるところまで来ました。

CUDAは、地味に見えて実は現代のテクノロジーを支える縁の下の力持ち。次にAIの話題を見かけたとき、その裏でCUDAが黙々と何億回もの計算をこなしていることを、ちょっと思い出してみてください。