HBM(High Bandwidth Memory)って、そもそもナニ?

はじめに

みなさんは「メモリ」と聞くと、パソコンに刺さっているあの板状の部品を思い浮かべるかもしれません。

でも最近、AI・機械学習・ゲームの世界では、「普通のメモリじゃ全然追いつかない!」 という悲鳴が上がっています。そこで颯爽と登場したのが、今回の主役 HBM(High Bandwidth Memory) です。

そもそもメモリって、何をしてるの?

コンピュータの中で、CPU(頭脳) や GPU(絵を描く専門家) は猛烈な速さで計算しています。でも計算するためには、データを手元に持ってこないといけません。そのデータを一時的に置いておく「作業台」がメモリです。

問題はここ。

「計算する人(CPU/GPU)はめちゃくちゃ速いのに、データを運ぶ道路が狭くて渋滞している」

これがボトルネック(足を引っ張る部分)になっていました。

合わせて読みたい

帯域幅とは?

メモリの性能を語るうえでよく出てくる言葉が 「帯域幅(バンド幅)」 です。わかりやすく言うと、

「1秒間にどれだけのデータを運べるか」 という「道路の広さ」のこと。

- 道路が狭い → 一度に少ししか運べない → 渋滞 → 計算が待たされる

- 道路が広い → 一度にたくさん運べる → スムーズ → 計算が速い

HBMの「H(High)」と「B(Bandwidth)」はまさにここを指しています。つまり 「めちゃくちゃ帯域幅が広いメモリ」 というのがHBMの正体です。

普通のメモリと何が違うの?

今まで主流だったのは GDDR(Graphics DDR) というメモリです。グラフィックカードなどに使われていて、みなさんもどこかで名前を聞いたことがあるかもしれません。HBMとGDDRの違いをざっくり比べてみましょう。

| GDDR(一般的なメモリ) | HBM | |

| 形 | 横に並べて実装 | 縦に積み重ねて実装 |

| 帯域幅 | 普通〜広め | 圧倒的に広い |

| 消費電力 | 多め | 少なめ |

| サイズ | 大きい | コンパクト |

| 値段 | 安い | 高い |

合わせて読みたい

HBMの最大の特徴:「縦に積む」という発想

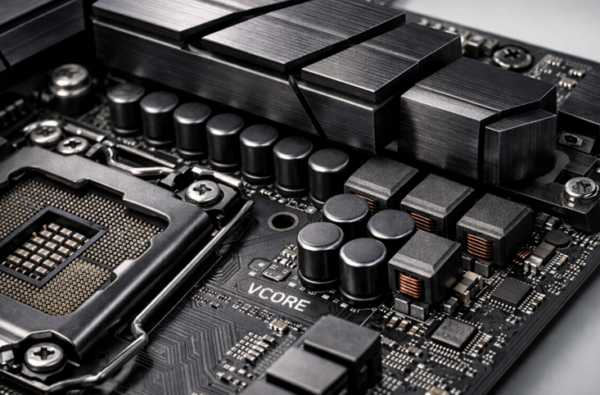

HBMがすごい理由は、その構造のユニークさにあります。従来のメモリは、チップを横にズラーッと並べて基板に実装していました。データを送る「道(配線)」は限られた数しかありません。

これに対してHBMは発想を根本から変えました。「横に並べるんじゃなくて、上に積めばいいじゃないか!」これが 「3Dスタッキング(3次元積層)」 という技術です。

メモリのチップを何層にも重ね、層と層の間を 「TSV(Through-Silicon Via)」 という細かい穴を通じた配線でつなぎます。この構造のおかげで、一度に運べるデータの量が爆発的に増えるというわけです。

もうひとつの工夫:「すぐ隣に置く」

HBMはもう一つ工夫をしています。

GPUなどのチップと、HBMを 「インターポーザー」 という基板の上に横並びで置いて、超近距離で接続するのです。信号を送る距離が短いと、より高速にデータを転送することが可能となるのです。

HBMはどこで使われているの?

実は、HBMはすでに私たちの身近なところで大活躍しています。

- AI・機械学習

ChatGPTのようなAIを動かす データセンターのGPU(NVIDIAのH100、B100など)には、HBMが搭載されています。AIの学習・推論には膨大なデータを高速処理する必要があるため、HBMは欠かせない存在です。

合わせて読みたい

- ハイエンドゲーミング・プロ向けグラフィックカード

AMD Radeonのプロ向け製品などにも使われており、超高解像度の描画処理を支えています。 - スーパーコンピュータ

天気予報や科学シミュレーションなど、膨大な計算をこなすスパコンにも採用されています。日本の「富岳」でも高帯域メモリが活用されています。

HBMの世代:どんどん進化している

HBMは登場してから着実に進化を重ねています。

| 世代 | 特徴 |

| HBM1(2015年〜) | 初代。AMDのGPUに初搭載 |

| HBM2(2016年〜) | 帯域幅・容量が大幅アップ |

| HBM2E(2020年〜) | HBM2の改良版。さらに高速・大容量 |

| HBM3(2022年〜) | NVIDIAのH100に搭載。爆速 |

| HBM3E(2024年〜) | 現在の最新主流。AI需要に対応 |

AI需要の急拡大にともなって、開発競争も激化しています。

HBMの課題:弱点もある

良いことばかりではありません。HBMにはいくつかの課題もあります。

- とにかく高い

製造プロセスが複雑なため、GDDRと比べて非常に高価です。消費者向けの普通のゲーミングPCには、コスト的にまだ採用しにくい状況です。 - 作れるメーカーが限られる

現在、HBMを製造できるのは実質的に SK Hynix・Samsung・Micron の3社のみです(特にSK Hynixが市場をリード)。需要が急増しても、すぐに供給量を増やせないという問題があります。 - 発熱・実装の難しさ

積層構造ゆえに熱がこもりやすく、高度な冷却技術も必要になります。

まとめ:HBMを一言で言うなら

「チップを縦に積み重ねることで、超広い『データの道』を実現した、次世代の高性能メモリ」

普通のメモリが「細い一本道」だとすれば、HBMは「広大な高速道路」。AIブームの今、この「高速道路」なしにはスーパーコンピュータもAIチップも成り立たないと言っても過言ではありません。