GPUDirectって、そもそもナニ?

はじめに

「GPUはAIや画像処理がめちゃくちゃ速い!」というのは、最近ではすっかり常識になってきました。でも、こんな疑問を持ったことはありませんか?

「GPUがいくら速くても、データを送り込む速さが追いつかなかったら、意味なくない?」

実は、これはとても鋭い指摘です。そして、その問題を解決するために生まれたのが 「GPUDirect」 という技術なんです。

合わせて読みたい

普通のデータの流れとは?

GPUDirectを理解するには、まず「普通の場合、データはどう動いているのか」を知る必要があります。

たとえば、ネットワーク経由で届いたデータをGPUで処理するケースを考えてみましょう。

普通の流れ(GPUDirect無し)

このように、データはまず CPUのメインメモリ(RAM)にいったん寄り道 してからGPUに渡されます。

ここでCPUは「配達員」のような役割を担っており、

- 「ネットワークからデータが来たよ!」と受け取って

- メモリに一時保存して

- 「じゃあGPUに送るか」とコピーして転送する

という作業をせっせとこなしています。

この「寄り道」、何が問題なの?

一見ちゃんと動いているように見えますが、実はこの方法には 3つの大きなムダ があります。

| 問題 | 内容 |

| 遅延が増える | 寄り道した分だけ時間がかかる |

| 余計なコピーが発生 | 同じデータをメモリ間でコピーする処理が無駄 |

| CPUに余計な負荷がかかる | 本来別の仕事をすべきCPUが「運び屋」として働かされる |

AI学習や科学計算など、毎秒ギガバイト単位のデータを処理するような場面では、このロスが積み重なって深刻なボトルネックになります。

そこで登場!GPUDirect

GPUDirect は、NVIDIAが開発した技術で、一言で言うと

「CPUやメインメモリを経由せず、GPUが直接データをやり取りできるようにする仕組み」

です。「Direct(直接)」という名前の通り、余計な中継をすっ飛ばしてしまおう、というわけです。

GPUDirectの種類

GPUDirectは実はひとつの技術ではなく、用途によっていくつかの種類があります。

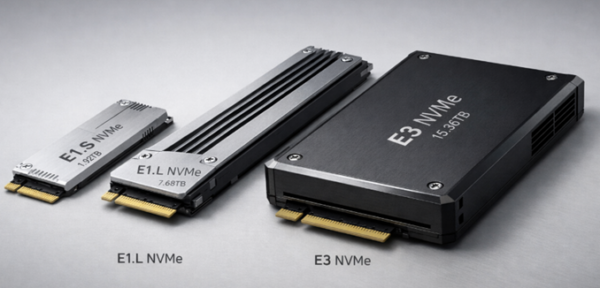

1.GPUDirect Storage (ストレージと直結)

ストレージ(SSDなど)のデータを、CPUのメモリを通さずに直接GPUへ転送します。

例えるなら: 図書館(ストレージ)から本(データ)を読みたいとき、司書(CPU)に頼まずに自分(GPU)が直接棚から取ってくるイメージです。

主な用途: 大量の画像や動画データをAIに学習させる場面

合わせて読みたい

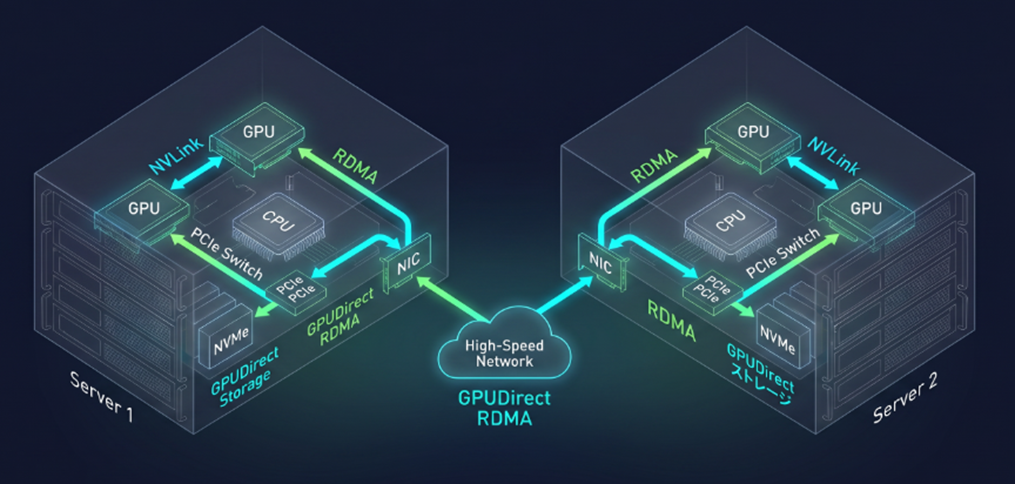

2.GPUDirect RDMA (ネットワークと直結)

ネットワークカードとGPUが直接やり取りします。RDMA(Remote Direct Memory Access)という技術を活用したものです。

例えるなら: 隣のオフィス(別のサーバー)から書類(データ)が届くとき、受付(CPU)を通さず、担当者(GPU)の机に直接届くイメージです。

主な用途: 複数のサーバーにまたがって分散AI学習を行う場面(超大規模なAIトレーニングなど)

合わせて読みたい

3.GPUDirect P2P (GPU同士を直結)

同じマシンの中にある複数のGPU同士が、CPUを介さず直接データをやり取りします。

例えるなら: 隣の席の同僚(別のGPU)にデータを渡すとき、わざわざ上司(CPU)経由で回さず、直接手渡しするイメージです。

主な用途: 1台のサーバーに複数のGPUを積んでAI学習を並列処理する場面

実際どのくらい速くなるの?

「理屈はわかったけど、実際の効果は?」という気になりますよね。GPUDirect RDMAの場合、条件にもよりますが、帯域幅が数倍向上し、レイテンシ(遅延)が大幅に削減されるというケースが多く報告されています。

特にAIの分散学習では、数十台〜数百台のGPUサーバーがお互いに大量のデータをやり取りするため、この差は非常に大きくなります。GPUDirectなしでは、そのままCPUがボトルネックになって、高価なGPUの性能を十分に発揮できないことになるのです。

ChatGPTのような大規模AIを支える縁の下の力持ち

実は、ChatGPTやGeminiのような巨大なAIモデルの学習には、数千〜数万台ものGPUサーバーが連携して動いています。そういった環境では、GPUDirectはなくてはならない技術です。

「速いGPU」+「速いつなぎ方(GPUDirect)」 = 本当の意味での高速AI処理

という図式が成り立っているわけです。

合わせて読みたい

まとめ

| ポイント | 内容 |

| 何が問題だったか | データがCPU・メインメモリを「寄り道」することで遅延とロスが発生 |

| GPUDirectとは | CPUを介さずGPUが直接データをやり取りできる技術 |

| 種類 | Storage(SSDと直結)・RDMA(ネットワークと直結)・P2P(GPU同士で直結) |

| 効果 | 遅延削減・帯域向上・CPUの負荷軽減 |

| 使われている場面 | 大規模AI学習・科学技術計算・高速データ処理 |

おわりに

「GPUが速い」というのは、あくまでも計算そのものの速さの話です。どんなに優秀なシェフがいても、食材の搬入がグダグダでは料理が遅くなるように、データの流れ方がボトルネックになることは珍しくありません。

GPUDirectは、そのボトルネックを解消するための「縁の下の力持ち」。派手な存在ではありませんが、現代のAIインフラを陰で支えている、とても重要な技術なのです。